Ollama: Voer Taalmodellen Lokaal Eenvoudig Uit

Ollama is een open source tool ontworpen voor Windows die gebruikers in staat stelt om elk taalmodel op hun lokale machine uit te voeren. Door gebruik te maken van de verwerkingskracht van je computer, maakt deze tool het mogelijk om antwoorden te genereren zonder afhankelijk te zijn van een online LLM. Zelfs met beperkte middelen zorgt Ollama voor consistente antwoorden, hoewel het langzamer is met inefficiënte hardware.

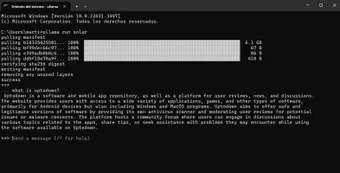

Het installeren van verschillende modellen zoals Llama 3, Phi 3, Mistral, of Gemma is eenvoudig met Ollama. Door specifieke commando's zoals 'ollama run llama3' in de console in te voeren, kun je het installatieproces starten. Ollama voert gesprekken via Windows CMD standaard en raadt aan om het dubbele van de vrije schijfruimte te hebben in vergelijking met de grootte van elk toegevoegd LLM voor optimale prestaties.